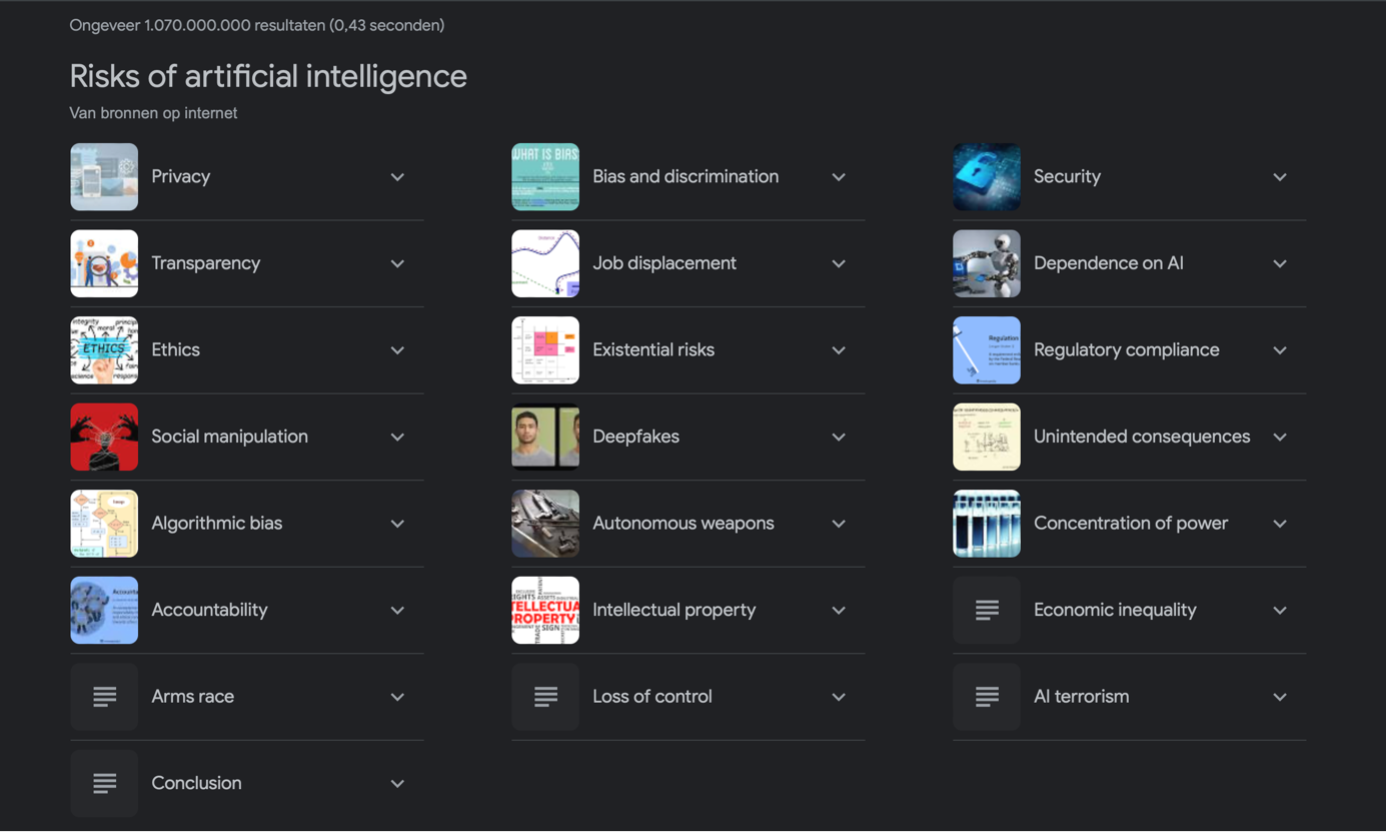

De onstuimige groei van AI brengt veel risico’s en uitdagingen met zich mee. Zoek maar eens op Google en je wordt overspoeld. AI biedt geweldige kansen maar er zijn ook risico’s waar we goed op moeten letten.

Bovenstaande risico’s kunnen worden onderverdeeld in verschillende categorieën, dus laten we ons concentreren op de risico’s die betrekking hebben op het testberoep. Ik heb zelf een selectie gemaakt en de volgende risico’s geïdentificeerd:

- Gebrek aan Transparantie

- Privacy

- Beveiliging

- Afhankelijkheid van AI

- Baanverlies

Ik heb veel artikelen gelezen om te begrijpen wat deze risico’s voor ons als testers inhouden. Aan het einde vind je een lijst van deze artikelen.

GEBREK AAN TRANSPARANTIE

Mensen begrijpen vaak niet waarom AI-modellen de beslissingen nemen die ze doen. Het begrijpen van hoe AI-systemen beslissingen nemen is cruciaal voor het opbouwen van vertrouwen en het waarborgen van verantwoordelijkheid. Veel AI-modellen, vooral deep learning-modellen, functioneren echter als “black boxes”, waardoor hun besluitvormingsprocessen ondoorzichtig en moeilijk te interpreteren zijn. Dit gebrek aan transparantie leidt niet alleen tot wantrouwen, maar roept ook ethische en juridische zorgen op, vooral in kritieke gebieden zoals gezondheidszorg en defensie. Om dit probleem aan te pakken, is de ontwikkeling van verklaarbare AI (XAI) essentieel. XAI streeft ernaar duidelijke en begrijpelijke uitleg te geven voor AI-beslissingen door de specifieke data en redeneringen te traceren die daartoe hebben geleid. Door transparantie te vergroten via XAI-technieken en beleidsmaatregelen, zoals transparantievereisten, kunnen we vertrouwen in AI-systemen bevorderen en ervoor zorgen dat ze verantwoordelijk en eerlijk worden gebruikt. Uiteindelijk is het bevorderen van transparantie in AI van groot belang om acceptatie te stimuleren en de voordelen van deze transformerende technologie te maximaliseren, terwijl potentiële risico’s worden geminimaliseerd.

PRIVACY

Wij als testers werken met testgegevens waarvoor we moeten zorgen dat deze gegevens niet herleidbaar zijn tot een persoon. De opkomst van AI-technologieën brengt aanzienlijke zorgen met zich mee over gegevensprivacy en beveiliging. Deze technologieën omvatten vaak het verzamelen en analyseren van enorme hoeveelheden persoonlijke gegevens, waardoor gebruikers kwetsbaar worden voor risico’s zoals datalekken, identiteitsdiefstal en surveillance. Het beperken van deze risico’s vereist strikte handhaving van gegevensbeschermingsregelingen en het gebruik van privacybeschermende technieken zoals encryptie en anonimisering. Gebruikers in staat stellen controle te hebben over hun gegevens is cruciaal. Het gebrek aan uitgebreide regelgeving verergert deze zorgen, met weinig wetten die specifiek gericht zijn op de privacy van AI-gegevens op nationaal of internationaal niveau. Terwijl initiatieven zoals de voorgestelde AI Act van de EU gericht zijn op het reguleren van hoog-risico AI-systemen, moeten er nog uitgebreide kaders worden vastgesteld. Naarmate AI steeds meer wordt geïntegreerd in het dagelijks leven, kan het belang van het beschermen van privacyrechten door middel van robuuste maatregelen en samenwerking tussen beleidsmakers, technologen en privacyadvocaten niet genoeg benadrukt worden. Het is van het grootste belang om deze uitdagingen aan te pakken om ervoor te zorgen dat de privacyrechten van individuen worden gehandhaafd in een AI-gedreven wereld.

BEVEILIGING

De vooruitgang van AI-technologie brengt niet alleen kansen met zich mee, maar ook aanzienlijke beveiligingsrisico’s. AI-systemen, zoals elke technologische infrastructuur, zijn vatbaar voor cyberaanvallen. Hackers kunnen AI-capaciteiten misbruiken om geavanceerde cyberaanvallen uit te voeren. Het verbeteren van de beveiliging houdt in dat robuuste AI-systemen worden ontworpen en ethische kaders worden geïmplementeerd. Internationale samenwerking is cruciaal om normen en voorschriften vast te stellen die bescherming bieden tegen AI-beveiligingsdreigingen. Het is van groot belang om deze uitdagingen aan te pakken om een verantwoordelijke en veilige ontwikkeling en inzet van AI te waarborgen.

AFHANKELIJKHEID VAN AI

Het wijdverspreide gebruik van AI-technologieën roept zorgen op over overmatige afhankelijkheid en potentiële verslaving bij gebruikers. Afhankelijkheid van AI-assistenten voor informatie of entertainment kan leiden tot verminderde kritische denkvaardigheden en sociale vaardigheden. Bovendien, naarmate AI onze ervaringen steeds meer begrijpt en aanpast, kan het essentiële menselijke eigenschappen zoals geduld, empathie en creativiteit ondermijnen. Deze overmatige afhankelijkheid kan leiden tot verlies van menselijke invloed in besluitvormingsprocessen, vooral in kritieke gebieden zoals gezondheidszorg en creatieve inspanningen. Het is essentieel om een balans te vinden tussen AI-assistentie en menselijke input om onze cognitieve vaardigheden te behouden en zinvolle menselijke interacties te onderhouden in een steeds meer geautomatiseerde wereld. Als testers zijn we kritische denkers. We moeten altijd de informatie van AI in twijfel trekken.

BAANVERLIES

AI-technologieën vormen een tweesnijdend zwaard voor de arbeidsmarkt, waarbij ze enerzijds zorgen voor verhoogde efficiëntie, maar anderzijds dreigen voor grootschalig baanverlies. Naarmate AI-gedreven automatisering verschillende sectoren infiltreert, worden routinetaken snel vervangen, wat een aanzienlijke uitdaging vormt voor laaggeschoolde werknemers. Deze verschuiving heeft zorgen gewekt over toenemende economische ongelijkheid en het potentiële verlies van doel en identiteit die gepaard gaan met traditioneel werk. Hoewel sommigen beweren dat AI meer banen zal creëren dan het elimineert, is de realiteit een complexe overgang die proactieve maatregelen vereist.

Het effect van AI beperkt zich echter niet tot laaggeschoolde sectoren. Zelfs beroepen die een hoge opleiding vereisen, zoals rechten en boekhouding, worden verstoord doordat AI-technologieën taken zoals contractbeoordeling en financiële analyse stroomlijnen. Hoewel automatisering potentiële voordelen biedt in termen van efficiëntie en nauwkeurigheid, roept het ook vragen op over de toekomst van menselijke arbeid en de maatschappelijke implicaties van een arbeidsmarkt die steeds meer afhankelijk is van machines.

In reactie op deze uitdagingen pleiten experts voor proactieve maatregelen zoals omscholingsprogramma’s voor werknemers en beleidswijzigingen om ontslagen werknemers te ondersteunen en de verwerving van nieuwe vaardigheden te faciliteren. Daarnaast is het essentieel om een cultuur van levenslang leren en aanpassingsvermogen te bevorderen voor individuen die navigeren in de snel veranderende arbeidsmarkt. Het omarmen van AI-technologieën vereist uiteindelijk een holistische benadering die prioriteit geeft aan mensgerichte oplossingen om de potentiële negatieve effecten op de arbeidsmarkt te verminderen en een welvarende toekomst voor iedereen te waarborgen.

Wij als testers hebben in het verleden al te maken gehad met problemen waarbij er een sterke overtuiging was dat automatisering de tester zou vervangen. Toch zijn we er nog steeds, omdat ons kritische denken en creativiteit nog steeds essentieel zijn om een goede testtaak uit te voeren. Zelfs ontwikkelaars die testers vervangen door het (geautomatiseerde) testwerk zelf te doen, was geen succes. De reden is dat je eerst moet testen voordat je kunt automatiseren. Ontwikkelaars zeggen dat testwerk niets is wat wij moeten doen (behalve unit testing, maar dat is een onderdeel van de ontwikkeling).

CONCLUSIE

We moeten duidelijke uitleg geven over de beslissingen die worden genomen bij het gebruik van AI om te helpen bij de besluitvorming. Het is essentieel om de diverse gegevens die we benaderen verantwoordelijk te beheren en te zorgen voor naleving van privacyregels, vooral bij het omgaan met persoonlijke gegevens. We moeten prioriteit geven aan de beveiliging van de AI-systemen die we gebruiken. Hoewel AI onze testprocessen kan verbeteren, is het cruciaal om een kritische blik te behouden. Het is belangrijk te erkennen dat AI dient als een assistent in plaats van een vervanger, waarbij het wordt gezien als een samenwerkingspartner of co-creator.

AI is snel, maar niet slim. Wij als mensen (gelukkig zijn testers ook mensen) voorzien AI van informatie. Als we AI iets vragen, krijgen we een snel antwoord. Maar wees je ervan bewust dat als je rotzooi in AI stopt, je er rotzooi uit krijgt.

Geschreven door: Peter Schrijver, Test Automation Engineer bij Argas